x2 ist nur FG, MFG ist alles ab x3.

Aber die Aussage passt irgendwie nicht, wie kannst Du x2 nicht bemerken und x3 z.Bsp. schon?

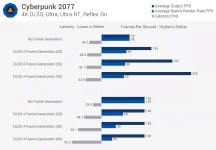

Um das mal zu visualisieren anhand von gemessenen Werten:

In Star Wars Outlaws haben wir hier bei einer Basisframerate von 109 ohne FG/MFG eine Latenz von 23.4, bei FG (also x2) steigt dieser auf 29.6, das ist eine Steigerung von 26,5% der Latenz. Von x2 auf x3 steigt dieser lediglich weitere 4%, auf x4 lediglich um weitere 3,9%.

Ein weiteres Beispiel (Hogwarts Legacy) mit niedrigerer Basisframerate (78):

Hier beträgt der Sprung auf x2 etwa 16,7%, auf x3 5,5% und auf x4 4,2%.

Worauf ich hinaus will:

Je höher die MFG Multiplikator, desto geringer die Auswirkung auf die Latenz, den größten Sprung gibt es immer beim Einschalten von FG, also x2.

Daher würde ich dazu raten wenn man schon FG einschaltet, dass dieser ruhig so eingestellt werden kann damit die maximale Bildwiederholfrequenz erreicht wird. Die 3-5% mehr Latenz die man bei höherem MFG Multiplikator hat wird man nicht merken wenn sich x2, also FG bereits gut anfühlt.

Das einzige was sehr wohl passieren kann sind Bildfehler bei höherem MFG Multiplikator, die halten sich bei DLSS 4.0 bereits meiner Meinung nach in Grenzen, mit 4.5 sowieso.

Wie ist eigentlich eure Erfahrung, mit den dargestellten, vielen Frames und den gefühlten an der Maus?

Grüße

Ich nutze in jedem Spiel eine Kombination aus DLDSR (AI Downsampling), DLSS und wenn vorhanden FG/MFG. Lediglich in MP Spielen wie z.Bsp. Battlefield 6 nutze ich kein FG, da ist jede ms Latenz zu viel schlecht. Aber in SP Spielen wo Grafik und Bildqualität wichtiger sind nutze ich es immer, und erreiche dadurch echt ein tolles Bild. Speziell jetzt mit DLSS 4.5 wo selbst der Performance Mode den alten Quality Mode übertrifft und damit jede Menge Performance freischaufelt.